轻松玩转书生·浦语大模型趣味 Demo

AI-摘要

切换

Tianli GPT

AI初始化中...

介绍自己

生成本文简介

推荐相关文章

前往主页

前往tianli博客

轻松玩转书生·浦语大模型趣味 Demo

🖊实验笔记

视频地址: 轻松玩转书生·浦语大模型趣味Demo

项目地址: 轻松玩转书生·浦语大模型趣味 Demo

InternLM是一个开源的轻量级训练框架,旨在支持大模型训练而无需大量的依赖。基于InternLM训练框架,上海人工智能实验室已经发布了两个开源的预训练模型:InternLM-7B和InternLM-20B。

Lagent是一个轻量级、开源的基于大语言模型的智能体(agent)框架,用户可以快速地将一个大语言模型转变为多种类型的智能体。通过Lagent框架可以更好的发挥InternLM模型的全部性能。

浦语·灵笔是基于书生·浦语大语言模型研发的视觉·语言大模型,有着出色的图文理解和创作能力,使用浦语·灵笔大模型可以轻松的创作一篇图文推文。

浦语·灵笔是基于书生·浦语大语言模型研发的视觉-语言大模型,提供出色的图文理解和创作能力,具有多项优势:

为用户打造

图文并貌的专属文章。设计了高效的训练策略,为模型注入

海量的多模态概念和知识数据,赋予其强大的图文理解和对话能力。

✍课程实验

基础作业:

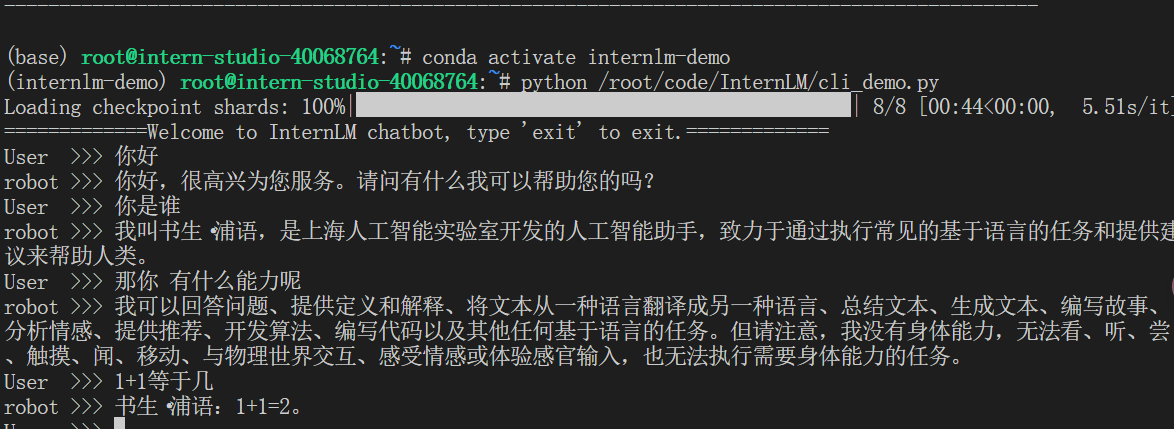

1.InternLM-Chat-7B 智能对话 Demo

1.终端界面

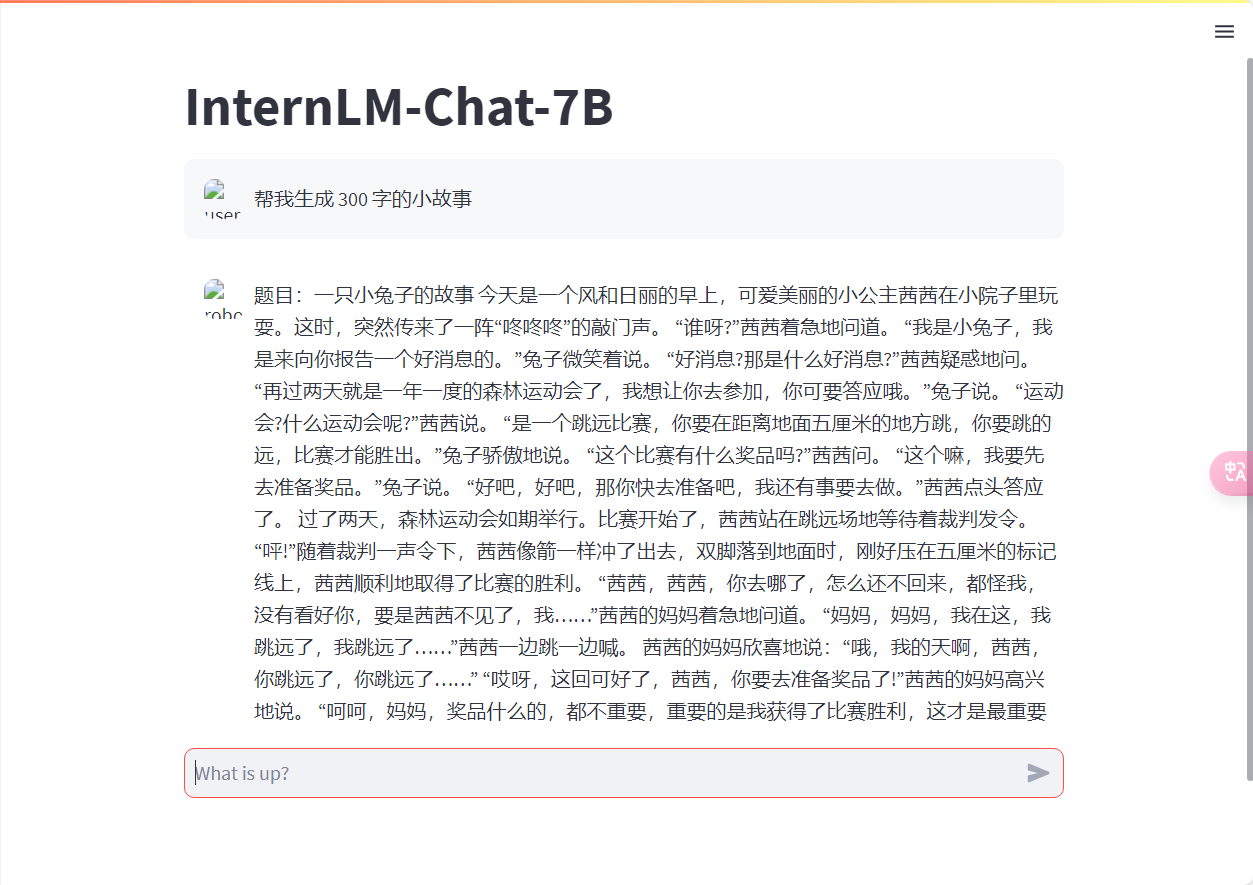

2.web界面

3.生成300字小故事

2.Lagent 智能体工具调用 Demo

我发现他这里面写的有python代码我们问一下他是不是根据代码得出的结果,结果很明显是的。

我发现他这里面写的有python代码我们问一下他是不是根据代码得出的结果,结果很明显是的。

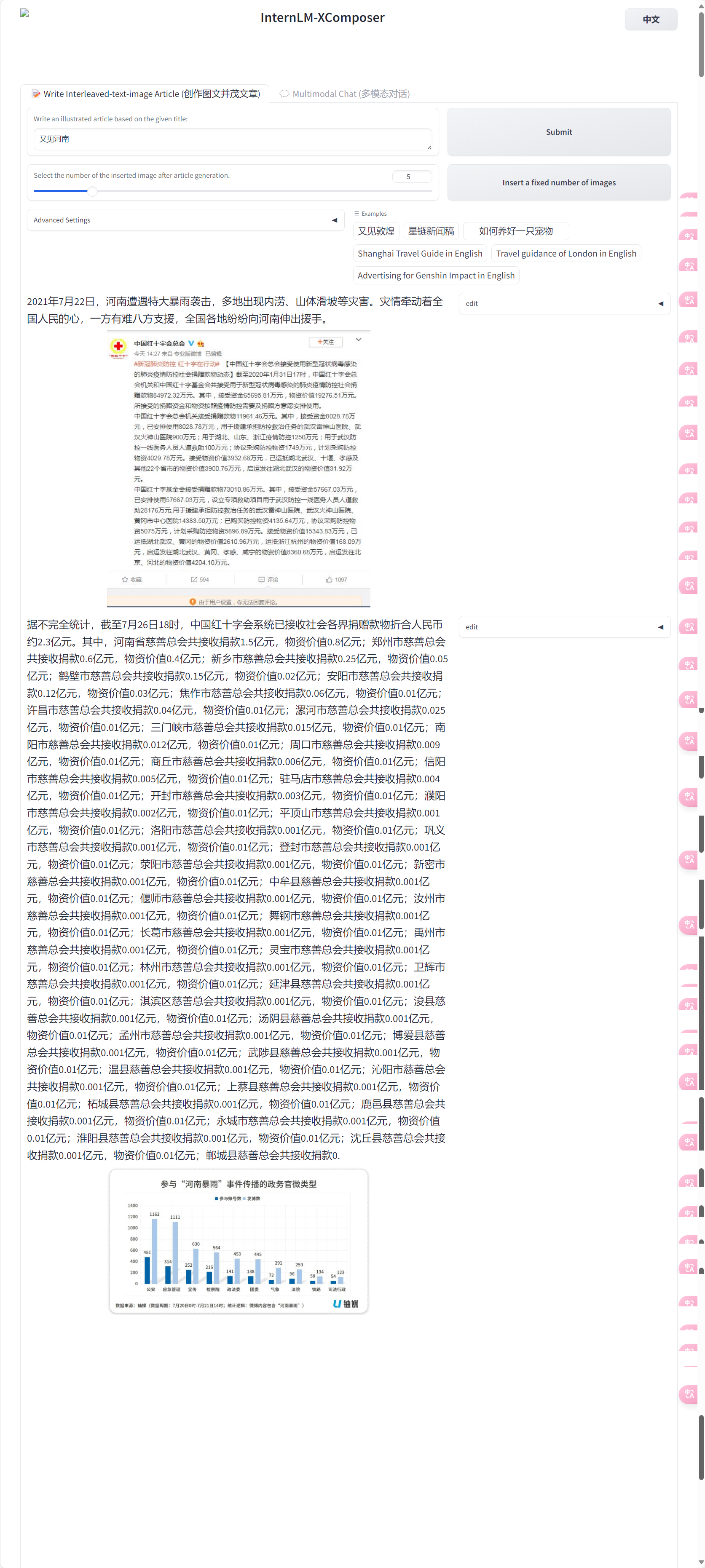

3.浦语·灵笔图文理解创作 Demo

如果遇到XComposer样式丢失请参考: InternLM-XComposer样式丢失

1.创作图文并茂文章

这里面数据集可能是之前的一些热点事件。

这里面数据集可能是之前的一些热点事件。

2.多模态对话

哈哈哈,看来模型的数据集还是比较少,里面有些东西它没有识别对。

进阶作业

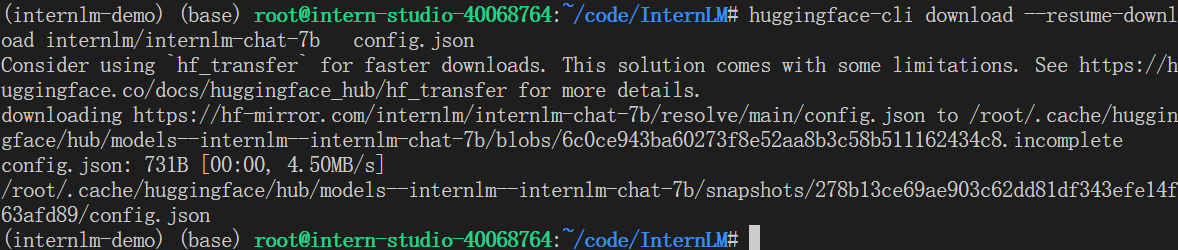

1.使用 huggingface_hub下载 InternLM-20B

pip install -U huggingface_hub

huggingface-cli download --resume-download internlm/internlm-chat-7b config.json截图:

- 感谢你赐予我前进的力量

赞赏者名单

因为你们的支持让我意识到写文章的价值🙏

本文是原创文章,采用 CC BY-NC-ND 4.0 协议,完整转载请注明来自 窝窝头

评论

匿名评论

隐私政策

你无需删除空行,直接评论以获取最佳展示效果